ඡායාරූප දෙකක් අතර Face Swap කිරීම දැන් ඉතාම සරල දෙයක් වෙලා. එහෙත්, Deepfakes දැන් වීඩියෝ සඳහා දැවැන්ත බලපෑමක් කරන්නට සමත්ව සිටිනවා. ලොව ප්රසිද්ධ චරිත දැනටමත් මෙයට ලක්ව ඇති අතර, පුද්ගල වීඩියෝ විශාල වශයෙන් අන්තර්ජාලයට එක් වන සමයක අන් හැමටත් එහි බලපෑම එල්ලවන්නට ඇති හැකියාව ඉතා ඉහළ යි.

හැඳින්වීම

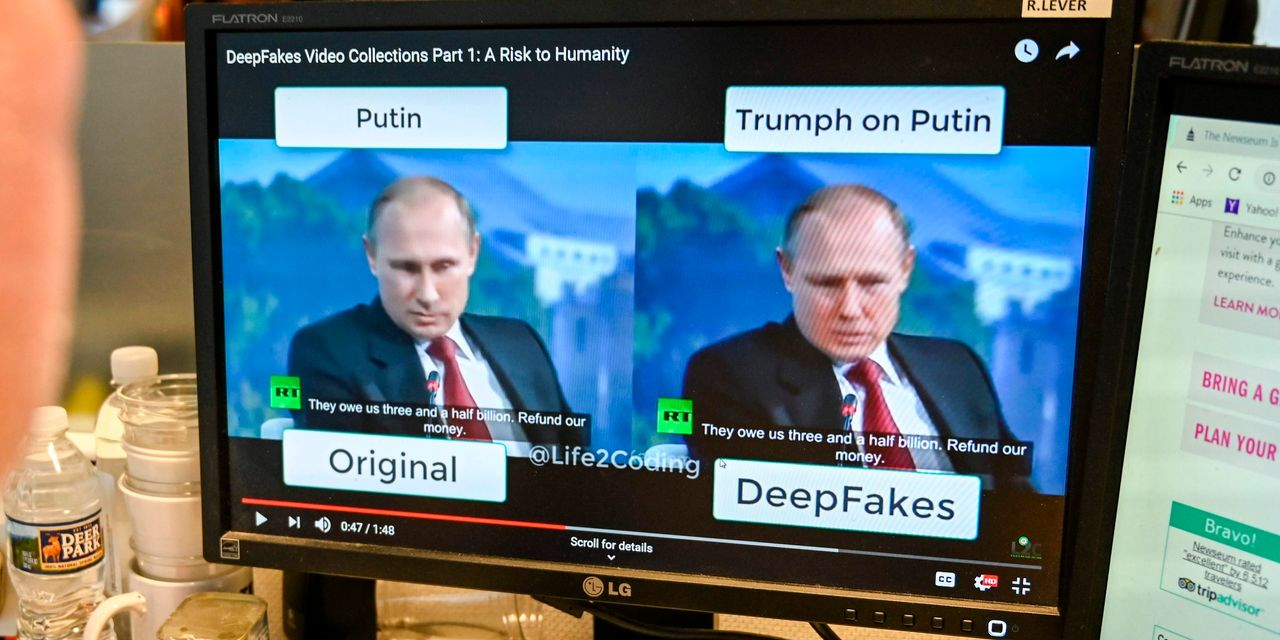

Deepfake යෙදුම් විවිධ ආකාරවලින් සකසනු ලබනවා. එක් ක්රමයක් නම්, කිසියම් පුද්ගලයකුගේ මුහුණේ ඉරියව් ගෙන, ඒවා තවත් කෙනෙක්ට යෙදීම. ඉහත ඇති වීඩියෝව එවැන්නක්. එහි දකුණු පස සිටින්නාගේ කථාව උපුටාගෙන එයට වම් පස ඔබාමාගේ මුහුණ යොදා තිබේ.

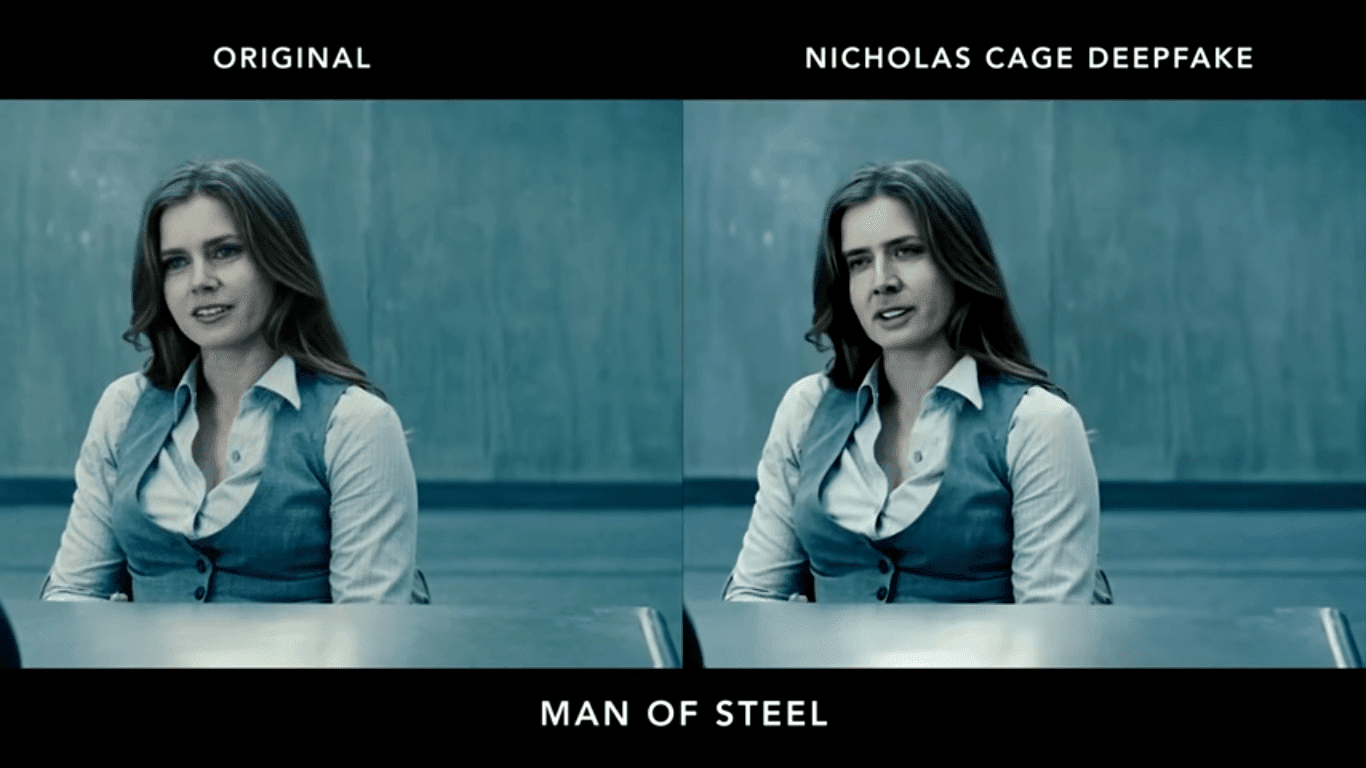

අනෙක් ක්රමය කිසියම් මුහුණක් ගෙන, එය චිත්රපටයක් වැනි වීඩියෝ වෙතට යෙදීම යි. Nicolas Cage රංගන ශිල්පියාගේ මුහුණ යොදා සකසන ලද එවන් වීඩියෝ තිබේ.

Deepfakesවලට එම “Deep” යන නම ලැබී ඇත්තේ Deep Neural Networks හෙවත් මහා පරිමාණ දත්තවල ඇති රටාවන් හා අන්යෝන්ය සබඳතාවන් හඳුනාගත හැකි AI ඇල්ගොරිතම යොදා ගන්නා නිසා ය. Fake යනු, ව්යාජ යන බව යි.

ක්රියාකරන ආකාරය

මෙම ස්නායුක ජාල (Neural Networks) පරිගණක දෘෂ්ටිය හෙවත් ඡායාරූප/වීඩියෝ විශ්ලේෂණයෙහි දස්කම් දක්වන්නක්. Deepfakes සඳහා යොදා ගැනෙන්නේ ස්වයං ආකේතක (autoencoder) ස්නායුක ජාල පද්ධතියකි. එහි කොටස් දෙකකි; 1) ආකේතකය – ඡායාරූපය කුඩා දත්ත සමූහයක් බවට පත් කරයි, 2) විකේතකය – වෙනස් කරන ලද එම දත්ත නැවත ඡායාරූපයක් බවට පත් කරයි.

නමුත්, පික්සල් සමූහයක් මත ක්රියා කරන සාමාන්ය ආකේතක / විකේතක මෘදුකාංග මෙන් නොව, Autoencoder ක්රියාත්මක වන්නේ රූප, හැඩතල, වස්තු සහ රටාවන් වැනි අංග මත යි. හොඳින් පුහුණු කළ එකකට නව ඡායාරූප ජනනය කිරීම සහ ඡායාරූපයක ඇති තිත් ගතිය ඉවත් කිරීම වැනි දෑ කළ හැකියි. මුහුණු සහිත ඡායාරූප මත ක්රියා කළ හැකි සේ සකසන ලද කල එය ඇහි බැම, ඇස්, නාසය, මුඛය යනාදිය හඳුනාගනියි. (මෙහි අප “ඡායාරූප” ලෙස කියා ඇත්තේ Frames ගැන ය. වීඩියෝවක් යනු ඡායාරූප/Frames රැසක එකතුවකි.)

Deepfake යෙදුම් එවන් Autoencoders දෙකක් භාවිතා කරනවා. එකක් නළුවාගේ මුහුණ යොදාගෙන පුහුණු කරවන අතර අනෙක, ඉලක්කගත පුද්ගලයාගේ මුහුණ සඳහා පුහුණු කරවයි. අනතුරුව, යෙදුම එම ප්රතිදානයන් දෙකම එක් කොට, ඉලක්කගත පුද්ගලයා වෙත නළුවා විසින් කරන-කියන දේ මුසු කරමින් නව වීඩියෝවක් සකසනවා.

VFX වෙනුවට Deepfakes යොදාගැනීමේ වාසි

මුහුණු දෙකක් මාරු කිරීමේ අපූරු හැකියාව ඇත්තේ Deepfakes සතුව පමණක් නොවේ. දෘෂ්ය ප්රයෝග හෙවත් VFX මඟින් මේ වන විටත් චිත්රපට ආදියේ මෙවන් දෑ දක්නට තිබෙනවා. එහෙත් ඒවා සැකසීමට ස්ටුඩියෝ තුළ දැඩි පරිශ්රමයක්, අධික මිලක් මෙන්ම ඉහළ හැකියාවන් ඇති පරිගණක ආදිය අවශ්ය වෙනවා.

Deepfakes සතු සුවිශේෂී බව වන්නේ, (ස්ටුඩියෝවලට සාපේක්ෂව) කුඩා පරිගණක පද්ධතියක් තුළින් ඕනෑම කෙනෙක්ට මෙය කරන්නට අවස්ථාව ලැබීම යි. හොඳ ප්රොසෙසරයක් සහ ජවයෙන් පිරි ග්රැෆික් ප්රොසෙසරයක් සහිත පරිගණකයක් හෝ ක්ලවුඩ් පරිගණකයකින් මෙය කරගන්නට හැකියාව තිබෙනවා. ඡායාරූපවල මුහුණු මාරු කිරීම් කරන සේවාවන් (Webtools, Apps) දැන් බිහිව අවසන්. එහෙත් තවමත්, වඩාත් සාර්ථක Deepfake එකක් සකසන්නට පරිගණකයට අමතරව ඔබට ද සුමට කිරීම් කරන්නට සිදුවෙනවා.

වීඩියෝ සැකසීමේ දී Deepfake AI සඳහා ඔබේ සහ ඉලක්කගත පුද්ගලයාගේ මුහුණේ විවිධ කෝණවලින් යුත් ඡායාරූප අවශ්ය වන අතර, වීඩියෝ රැසක් ආදානය කොට ඒවායේ ඇති Frames තුළින් එම දැනුම ලබා ගැනෙනවා. ජනපතිවරු, නළුවන් වැනි ප්රසිද්ධ පුද්ගලයන්ගේ මුහුණු අනුකරණය කරන ලද Deepfakes බහුල මේ නිසා යි. යොදාගන්නා දෘඪාංග සහ ආදාන දත්තවල ගුණාත්මක බව අනුව, මෙම පුහුණු කිරීම සඳහා ගත වන කාලය සති හෝ මාස ගණනක් විය හැකියි.

හොඳ සහ නරක

Deepfake යනු චිත්රපට කර්මාන්තයට සුබ ආරංචියක්. ජනහද දිනූ ෆිල්ම් සීරීස්වල නළු නිළියන්ගේ මුහුණට හානියක් වූ කල, වියපත් වූ කල, හෝ අභාවප්රාප්ත වූ විට පෙර ආකාරයෙන්ම සාර්ථක නිර්මාණයක් පහසුවෙන්ම කරන්නට මින් අවස්ථාව ලැබෙනවා.

හොඳම උදාහරණය Star Wars: Rougue One (2017) චිත්රපටියේ ලේයා කුමරියගේ දසුන යි. කැරී ෆිෂර් නිළිය හැට හැවිරිදි වියේ දී (2016 දී) මියගොස් තිබුණා. එසේම, ඇගේ තරුණ විය චිත්රපටයට අවශ්ය වුණා. මේ සඳහා වෙනත් නිළියක් හා CGI යොදාගැනුණු අතර, ඊට එම නිළියගේ මුහුණ මත තිත් සලකුණු යොදා දැවැන්ත පරිශ්රමයකින් තත්පර කිහිපයක ජවනිකාවක් සැකසුණු අතර, ඇය පවසන්නේ “Hope” යන තනි වචනය පමණයි. Deepfake තිබුණා නම් එය එතරම් සංකීර්ණ නොවන්නට තිබුණා.

විවෘත කේත යෙදුම් වශයෙන් ඕනෑම කෙනෙක්ට නිදහසේ භාවිතා කළ හැකි මෙම Deepfake යෙදුම් නිසා, ඩොනල්ඩ් ට්රම්ප්ගේ මුහුණට Mr. Beanගේ මුහුණ යොදා සැකසූ විනෝදජනක වීඩියෝ බිහි වුණා.

ගැටළුව නම්, දරුවන්ට අකුරු ලියන්නට ඇති පැන්සලෙන් John Wick මිනීමැරීම හෙවත් Deepfake තාක්ෂණයේ අවභාවිතය නිසා චරිත ඝාතනයන් සිදුවීම යි. ප්රසිද්ධ මුහුණු ඇති ව්යාජ නිල් චිත්රපට, දේශපාලනඥයන් හා ප්රසිද්ධ චරිත විසින් කරන ලදැ යි මුදාහැරෙන අසත්ය ප්රකාශවලින් අන්තර්ජාලය පිරී ගියා.

Reddit හි deepfakes නමින් පෙනී සිටින්නකු Wonder Woman හි දැන් රඟපාන Gal Gadot නිළියගේ, ගායිකා Taylor Swift, Game of Thrones හි ආර්යාට රඟපෑ Maisie Williams යනාදීන් යොදාගෙන නිල් චිත්රපට සකසා තිබුණා. රුසියානු ජනපති පුටින්, ඇමරිකාවේ හිටපු ජනපති බැරැක් ඔබාමා යොදාගෙන විවිධ ප්රකාශයන් සිදුකරන ආකාරයේ ඒවා බිහි වුණා. මේවා Deepfakes නිර්මාණ මඟින් චරිතඝාතන සහ ජනතාව නොමඟ යවනසුලු දෑ බිහිවීම නොවැළැක්විය හැකි බවට පෙරනිමිති වනවා.

Deepfakes හඳුනාගැනීම

Deepfakes යනු සෑම Frame එකකම කිසියම් කොටසක් වෙනස් කරන ලද වීඩියෝ බැවින් ඇසි පිල්ලම් ගහන ආකාරය, සමේ වර්ණය ආදිය මඟින් මිනිස් ඇසින් හඳුනාගත හැකි යි. එහෙත්, පුහුණු කරන AI එකකට ඊටත් වඩා සූක්ෂ්මව එය කරන්නට හැකියාව පවතිනවා. ඒවා Frame එක තුළ වෙනස් කරන ලද කොටස් හඳුනාගනු ඇති.

කැලිෆෝනියාවේ රිවර්සයිඩ් විශ්වවිද්යාලය සකසන ලද ස්නායුක ජාලයක් එසේ ක්රියා කරන අතර, එංගලන්තයේ සරේ විශ්වවිද්යාලය Blockchain එකක් මඟින් දැනට ඇති සත්ය වීඩියෝ එකතුවක් සකසා, ඒවාට එරෙහිව Deepfakes සංසන්දනය කරන ක්රමවේදයක් සකසා තිබෙනවා.

ඇමරිකානු ආරක්ෂක දෙපාර්තමේන්තුවේ DARPA පර්යේෂණ නියෝජිතායතනය විසින් ද මේ වෙනුවෙන් ක්රියා කිරීම අරඹා ඇති අතර, මයික්රොසොෆ්ට් සහ ෆේස්බුක් වැනි ආයතන විසින් එවන් යෙදුම් නිර්මාණය සඳහා ක්රමලේඛකයන් පොළඹවමින් තරග සංවිධානය කරන ලදී.

“මෙය අභියෝගාත්මක ගැටළුවක්. සයිබර් ආරක්ෂණයේ දී කෙතරම් ආරක්ෂාකාරී ක්රමවේදයන් සොයාගත්ත ද, ආක්රමණිකයා විසින් තවත් ක්රම සොයාගනියි.” මේ සම්බන්ධ පර්යේෂණ කරන විදුලි හා පරිගණක ඉංජිනේරු ශිල්පය පිළිබඳ මහාචාර්යවරයකු වන අමිත් රෝයි පවසනවා.

ඉන් අදහස් වන්නේ; සක්රීයව ඉදිරියට යන මේ නව තාක්ෂණයෙන් ගැලවීමට ද සක්රීයව ක්රියා කළ යුතු බව යි. සමාජ මාධ්ය හරහා සියල්ලෝම තමන්ගේ වීඩියෝ ප්රචලිත කරනවා. ඒවා යොදාගෙන ඔබේ මුහුණ සහිත අනර්ථකාරී වීඩියෝවක් සකසා චරිත ඝාතනයක් සිදුකළහොත්, එය කොතැනින් නම් කෙළවර විය හැකි ද?